Недавние тренды рунета

Наше “Я” — история написанная другими

Что имел в виду Карл Фристон

Многие интереснейшие высказывания Карла Фристона мало кто понимает, — слишком сложные мысли, слишком мудрёно поданные слишком мудреным языком. И здорово, что хоть изредка кому-то удается облачить эти мысли в понятные слова, рассказанные понятным образом.

Поэтому весьма рекомендую этот 6 минутный ролик Дарио Веллирилли (Dario Villirilli).

А здесь текст озвучки. В этом ролике разъясняется фраза Фристона, будто наша идентичность, самоощущение, чувство собственного «я» — не что иное, как история, которая пишется в нашей памяти большим коллективом авторов (по сути, всеми, с кем мы очно и заочно знакомимся после 3-х лет и до смерти).

Вот это место в интервью.

Фристон говорит следующее:

«Если я живу в мире, состоящем из таких же как я — в социальном мире, в сообществе, — мне необходимо понимать, что это я говорю, а не кто-то другой. Но мне это не понадобилось бы, если б я был один одинешенек на Марсе или если б я рос диким ребенком в джунглях».

Расшифровывая и развертывая эту фразу, Веллирилли, объясняет.

✔️ Ваше “Я” — творение вашего мозга, полученное на основе схемы социальных коммуникаций, сформулированной еще Чарлзом Кули:

«Я не то, что я о себе думаю, и я не то, что другие думают обо мне. Я то, что я думаю о том, что другие обо мне думают».

✔️ Наша идентичность — это сложная история, создаваемая нами в соавторстве с людьми, с которыми общаемся на протяжении всей жизни. Мы пишем эту историю, делясь мнениями в кругу семьи, сплетничая на работе, делясь воспоминаниями в социальных сетях или болтая с другом. Но мы также пишем её в своей голове, например, когда находимся в душе, прокручивая разговор с партнером, задаваясь вопросом, что мы могли бы сказать по-другому, или представляя себе будущее, пытаясь предугадать, что бы мы могли сказать, изменись ситуация.

✔️ Мы часто неправильно воспринимаем свою идентичность, как реальную сущность, тогда как, на самом деле, — это просто ментальная конструкция, записанная в виде истории в мозге. Попадая в эту ловушку — историю о том, что, по нашему мнению, другие люди ожидают от нас, — мы тратим жизнь, пытаясь, будто бы, улучшить представления о нас других людей, а вовсе не то, что мы, на самом деле, чувствуем.

✔️ Причина вышеназванного в том, что эволюция вложила в мозг примата механизм формирования личности — ментальной конструкции в виде записи истории социальных представлений и отношений. Этот механизм был нужен эволюции для колоссального рывка приспособленности вида. Он достигался неограниченно масштабируемым сочетанием социального обучения и сотрудничества. Но цена этого для индивида оказалась весьма высока: тревога, подавленность, невыносимая душевная боль, комплексы и т.п. — все это не существует в реальной жизни, а лишь является результатом неумения «обезьяньего мозга» справиться со слишком сложной историей, записанной в него другими.

Поэтому так важно выбирать себе личность с умом. Активно и осмысленно участвовать в написании истории собственной личности. И не позволять другим напихать всякой ерунды и гадости в ваш собственный мозг. Ведь вам потом с этими представлениями о себе жить.

________________________________

Если понравился пост:

- нажимаете на кнопку аплодисментов, — автору будет приятно :-)

- подпишитесь на обновления канала на платформе Medium;

- оставьте комментарий.

Еще больше материалов на моем Телеграм канале «Малоизвестное интересное». Подпишитесь

Оригинал и комментарии

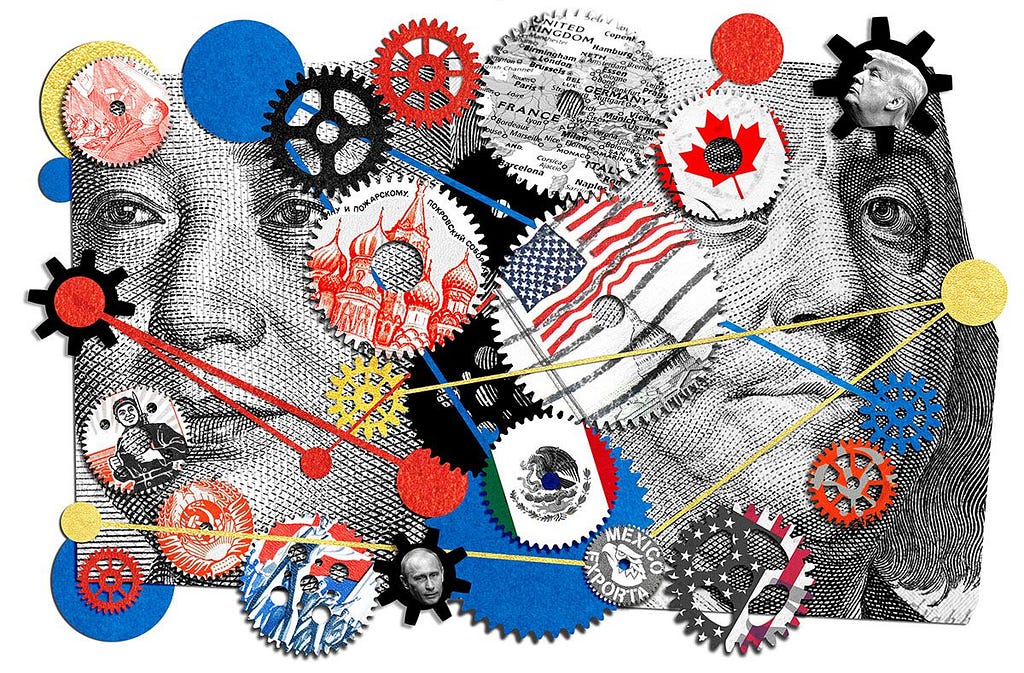

ИИ Китая и США — далеко не одно и то же

Станет ли это решающим фактором их противостояния

Hастоящий пост о том, почему к 100-летию КНР в 2049 юань и мандарин, а не доллар и английский могут стать общепринятыми для всего человечества.

Резюме таково

✔️ Превосходство в технологиях искусственного интеллекта (ИИ) становится ключевым условием обладания статуса сверхдержавы в 21 веке.

✔️ Считается, что в области ИИ два ключевых преимущества Китая — колоссальные объемы данных и авторитарный режим.

✔️ В США хотят нейтрализовать эти преимущества сменой госстратегии в области ИИ, устанавливая главными приоритетами обновленной стратегии:

— обесценивание превосходства в объеме данных для машинного обучения, путем соверщенствования алгоритмов и архитектур;

— централизацию управления R&D за счет передачи лидерства в этой области от частного бизнеса к государству (как это было во времена Манхэттенского проекта).

✔️ Однако, главное преимущество Китая вовсе не в объеме данных и авторитаризме. США, как и весь западный мир, не хотят видеть, что китайский и западный подходы к ИИ имеют принципиальные отличия, дающие потенциальное преимущество Китаю. И эти отличия не компенсируются предложенными изменениями в госстратегии США.

Как в США хотят улучшить ИИ стратегию

3автра Центр двухпартийной политики США представит свои рекомендации по национальной стратегии ИИ для Конгресса США. Суть рекомендаций такова.

Для сохранения статуса единственной сверхдержавы в 21 веке, США обязаны сохранить первенство в ИИ. И сделать это нужно во что бы то ни стало. Иначе Китай и Россия замесят США и низвергнут их с Олимпа.

Чтобы разобраться в деталях рекомендаций Конгрессу, можно прочесть четыре сопроводительных отчета, перейдя по приведенной выше ссылке. А можно сэкономить время, прочтя лишь меморандум «Как сделать 21 век еще одним веком Америки», опубликованный на этой неделе одним из двух лидеров проекта Уиллом Хердом — конгрессменом от Техаса, сделавшим карьеру в качестве тайного сотрудника ЦРУ, «останавливая террористов, предотвращая кражу наших секретов российскими шпионами и выводя из бизнеса распространителей ядерного оружия».

«Меморандум Херда» прям и конкретен:

- К 100-летию КПК в 2049 в мире будут царить либо мандарин и юань, либо английский и доллар.

- Китай — «плохой парень», и план его сдерживания должен быть предельно жёстким.

- Ни нынешняя, ни предыдущая администрация не смогли выполнить этот принцип.

- Только доминирование в ИИ обеспечит США сохранение статуса доминирующей боевой силы в мире.

- Чтобы не потерять преимущество в передовых технологиях, нужно кратно наращивать федеральные расходы на R&D и обеспечить здесь альянс частного бизнеса с государством при лидерстве последнего.

На первый взгляд, этот меморандум выглядит резонным. Но зададимся вопросом — хватит ли этого для первенства США в ИИ? Судя по тому, что США до сих пор не понимают истинного источника преимуществ Китая в этой области, действий в духе «Меморандума Херда» может оказаться недостаточно. США (и всему Западу) необходимо понять, что «китайский ИИ» и «западный ИИ» — далеко не одно и то же.

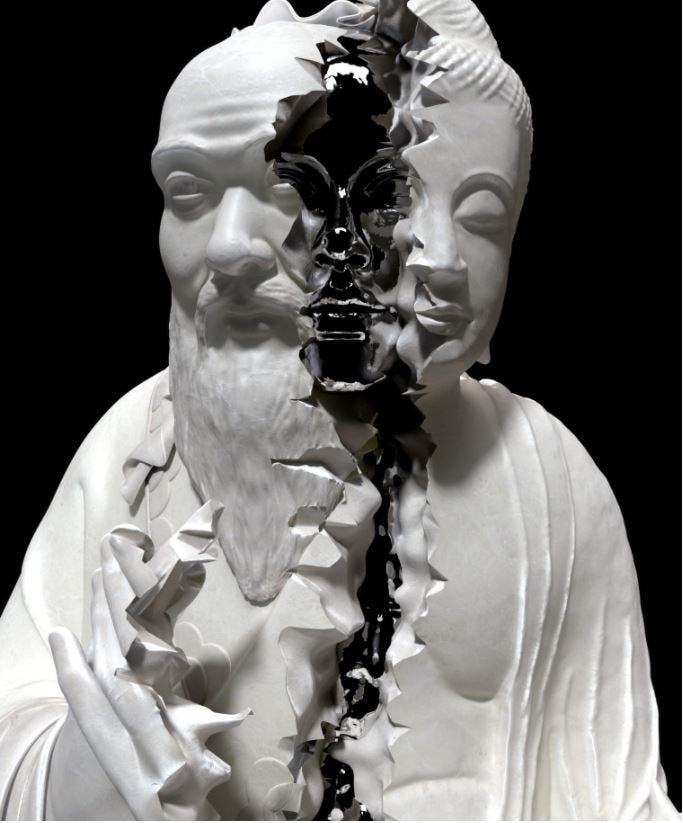

В чём специфика китайского подхода к ИИ

У меня давно не доходили руки написать о том, насколько велика эта разница в подходах к ИИ. А теперь уже и не нужно. Ибо это превосходно сделала Бин Сон — главный редактор сборника “Intelligence and Wisdom: AI Meets Chinese Philosophers”, занимающая позицию вице-президента и директора Центра Китая в Berggruen Institute (подробней об этом уникальном и крайне интересном институте читайте в моем посте «На смену человечеству идет новый вид. Каким он будет, зависит от Китая, если Запад, наконец, не одумается»).

В только опубликованном великолепном эссе «ИИ в свете древнекитайской философии» Бин Сон пишет о том, что остается скрытым от глаз большинства даже самых проницательных экспертов по ИИ. Понять, насколько различны китайское и западное отношение к ИИ, можно, посмотрев через призму различий их оценок потенциальных рисков использования ИИ.

✔️ Для Запада ИИ — источник экзистенциальных рисков, а для Китая — исключительно мощный инструмент (типа лазера), применять который нужно осторожно, ибо он становится опасным при неумелом или злонамеренном применении.

✔️ Для Запада ИИ — соперник человека, а для Китая — даже не партнер, а лишь сильно продвинутое средство достижения старых и, главное, - открытия новых целей (типа все того же лазера).

✔️ Для Запада нужно срочно разрабатывать мораль для ИИ, а для Китая очевидно, что невозможно сделать «морально здоровый ИИ», если люди сами не будут этически рефлексивны и ответственны.

Причина этих радикальный отличий в философских основах общества (христианство на Западе; конфуцианство, даосизм и буддизм в Китае), сформировавших за многие поколения разное понимание места человека в мироздании и разное отношение индивида к обществу.

Эта разница формирует в китайском и западном обществах (и в конкретных их представителях: ученых, инженерах, политиках, военных) разные “ядра патернальных культур” — разные сочетания врожденных представлений, ценностей, норм, идей (подробней см. в великой книге Карла Кантора “Двойная спираль истории: Историософия проектизма”).

В результате, в западном и китайском обществах складываются различные представления о том, “что такое хорошо, и что такое плохо” в области технологических инноваций в целом и, в частности, в области ИИ.

- На Западе царит антропоцентризм. Человеческие существа рассматриваются отдельно от природы и выше ее. Homo sapiens, с их уникальной рациональностью, самосознанием и субъективностью, ставятся выше других животных, растений и других форм жизни.

- В Китае царит неантропоцентризм. Ни одна из трех господствующих школ китайской философии не ставит человека на первое место во Вселенной. Люди могут процветать и жить устойчивой жизнью, только если они следуют законам природы и достигают единства природы и человека.

- В Китае индивид не выделяет себя из общества (Я — это ОНИ). Как это сформулировал К.Кантор, — общество безраздельно господствует над индивидом прежде всего в его сознании, и только поэтому он умаляет себя перед обществом, перед всем, что это общество олицетворяет, — перед вождями, шаманами, символами.

- На Западе индивид обособился от общества и противопоставляет себя ему (Я против НИХ). Снова цитируя К.Кантора, — этот индивид находится в состоянии постоянной борьбы со всем светом, с обществом, с другими людьми и с самим собой.

- На Западе ИИ трактуется как интеллект, которому суждено догнать и превзойти человека.

- В Китае мало кого убеждает перспектива превосходства машинного интеллекта над человеческим. По их философии, люди всегда жили среди иных форм существования, которые могут быть более способными в некоторых отношениях, чем люди. Кроме того, ИИ не является “естественным” развитием человеческого интеллекта, поэтому, с точки зрения единства человека и природы, ИИ разработка должна руководствоваться, а иногда и подавляться уважением к естественному образу жизни.

- На Западе развитие ИИ движимо стремлением к максимальному созданию богатства и необузданному индивидуализму.

- В Китае социальное благо начинается в индивидуальном самосовершенствовании и связано с ним. ИИ при таком подходе становится помощником государства в деле совершенствования индивидов для максимизации социального блага (отсюда и полная толерантность к всеобщему наблюдению Большого брата и никаких моральный страданий граждан от проживания во всекитайском паноптикуме).

✔️Из вышесказанного следует, что там, где Запад упирается в частокол труднопреодолимых проблем в развитии и применении ИИ, у Китая подобных проблем в принципе нет.

Список таких проблем обширен. Вот лишь некоторые: приватность, конфиденциальность, права на данные, ограничение свобод индивида и бизнеса, примат общечеловеческих ценностей, этические ограничения при достижении целей, согласование моральных принципов сторон, юридическая ответственность, общественное благо.

Отсутствие у Китая большинства из перечисленных факторов, сдерживающих развитие и внедрение технологий ИИ на Западе, может превратиться в решающее преимущество Китая в борьбе за статус мирового ИИ лидера и связанного с этим признания сверхдержавой №1.

И здесь нужно особо отметить, что роль перечисленных сдержек нарастает по мере совершенствования технологий. Пока объемы онлайн операций были ограничены, число самоуправляемых авто на улицах составляло десятки, а востребованность массового отслеживания передвижений граждан отсутствовали, — главное преимущество Китая оставалось номинальным. Теперь, когда онлайн операции начали доминировать над офлайном, число самоуправляемых авто на дорогах неуклонно растет, а массовое отслеживание за передвижениями граждан превратилось во всеобщий приоритет, — главное преимущество Китая уже в ближайшие годы станет не просто ощутимо, но и превратится в основной фактор, определяющий скорость развития технологий ИИ.

Так что намерения США навалиться на Китай финансированием и хитрой стратегией R&D могут не сработать. Еще Сухов, комментируя ограниченную применимость западных подходов, заметил: «Восток — дело тонкое».

P.S. О том, почему на открывающей пост картинке место России столь невелико, надо бы написать отдельный пост.

________________________________

Если понравился пост:

- нажимаете на кнопку аплодисментов, — автору будет приятно :-)

- подпишитесь на обновления канала на платформе Medium;

- оставьте комментарий.

Еще больше материалов на моем Телеграм канале «Малоизвестное интересное». Подпишитесь

Оригинал и комментарии

Магические жесты подсознательного влияния

Новое исследование переворачивает представления о методах подсознательного влияния на аудиторию. Оказалось, что при обработке избирателей можно обойтись без навороченных словесных хитросплетений, а ля НЛП. И не так уж нужны знойные красавицы, детки и котятки в кадрах рекламы, склоняющей к покупке пылесоса. Оказывается, можно просто использовать пару жестов, и аудитория послушно последует за навязываемым ей выбором. Но главное, что кардинально отличает «магические жесты» от НЛП и красоток в кадре, — заметить такое влияние люди не в состоянии. А не заметив, они не смогут поставить ментальный блок такому влиянию.

Что же до оригинальности и научной новизны исследования отделения психологии Лондонского универа, то оно показало

колоссальную уязвимость когнитивной обработки мозгом разных типов поступающей в него информации. Хакнуть человека гораздо проще, чем считалось.

И всякие «маги» начали использовать подобные «магические жесты» задолго до этой публикации в Трудах Национальной академии наук США.

Сначала маленький экскурс в оптические иллюзии, показывающий крайнюю уязвимость восприятия. Вот уже полгода, как иллюзия будто бы вращающихся кубов будоражит пользователей сети, практически не оставляя равнодушных. Эта иллюзия действительно поражает.

Синие каркасы двух кубов на мигающем черно-белом фоне, несомненно, вращаются в разных направлениях, время от времени меняя направление вращения. Но никакого вращения нет. И вся эта иллюзия — результат «фи-феномена», открытого Вертхеймером в 1910 году и положившего начало возникновению школы гештальт — психологии.

Быстрое мигание между белым и черным фоном, наряду с изменением цвета контуров граней кубов заставляет мозг воспринимать два неподвижных куба вращающимися.

Проверить, что это так, не просто. Вы можете упереться пальцем в середину передней грани куба, и он на пару секунд остановит вращение. Но еще через секунду куб резко изменит угол наклона, как бы уворачиваясь от вашего пальца, и снова начнет вращаться, продолжая обманывать восприятие.

Видите, насколько иллюзорен мир, реконструируемый мозгом. А теперь посмотрим, как можно использовать уязвимости восприятия для манипулирования людьми, незаметно влияя на их выбор.

Исследование «Influencing choices with conversational primes: How a magic trick unconsciously influences card choices» посвящено эффекту прайминга, заставляющего мозг интерпретировать событие или информацию в контексте предшествовавшего. Этот эффект, широко используемый в рекламе и прочих технологиях влияния на людей, известен каждому. По его милости сразу после фильма ужасов многие опасливо озираются в собственной квартире, а сексуальная красотка в начале рекламного ролика позитивно влияет на восприятие мужчинами рекламируемой затем лопаты.

Новое исследование копнуло глубже. А можно ли заставить людей совершать определенный выбор такими нейтральными действиями, чтобы люди этого никак не заметили. Т.е. никаких слов убеждений, красоток, красавцев, детишек, котиков и т.д. Просто пара нейтральных жестов, и люди делают нужный вам выбор.

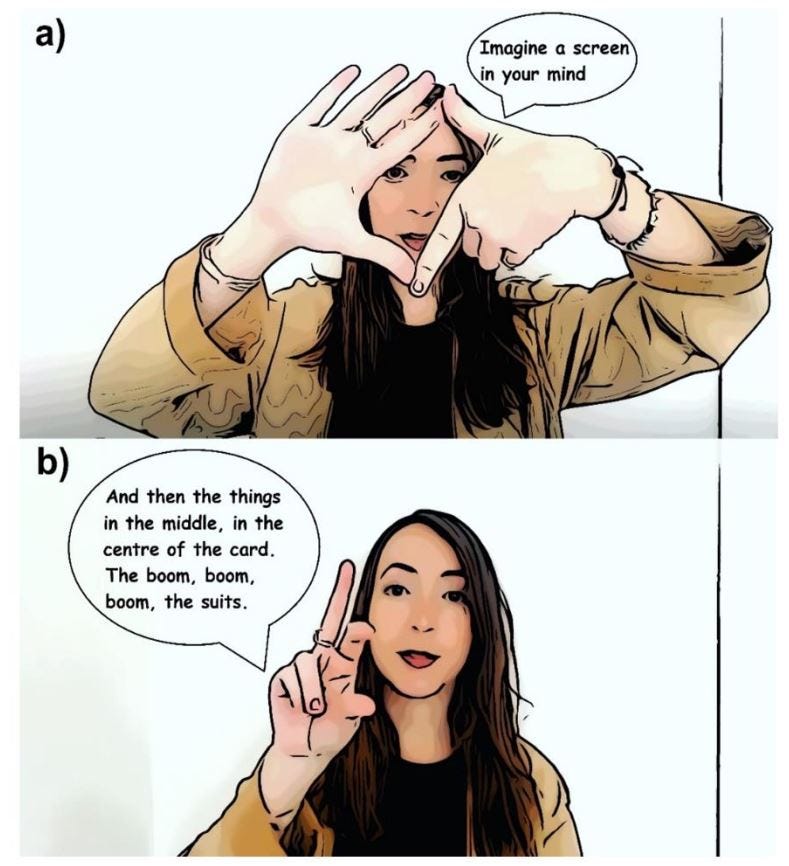

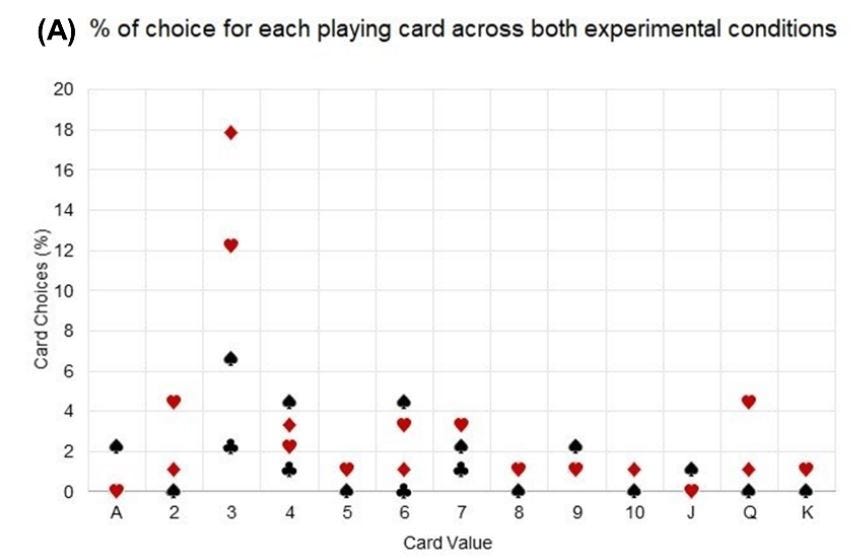

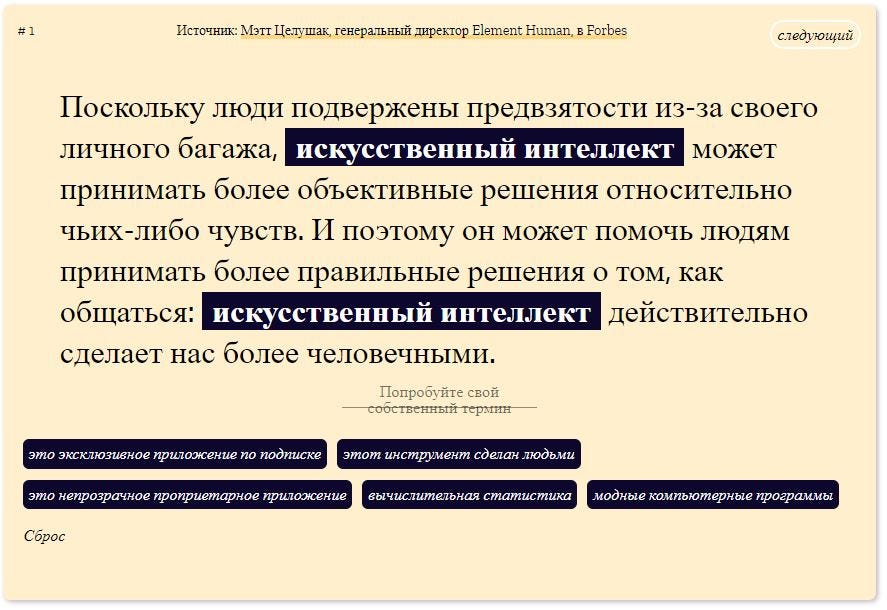

Оказалось, можно. Чтоб заставить среди карт выбирать тройку бубен, исследователи несли перед испытуемыми полную пургу, временами используя в жестикуляции «магические жесты», которые мозг может бессознательно ассоциировать со знаком бубен и тройкой. Например (см. открывающий пост рисунок),

Рисунок a): пальцы в форме ромба при фразе «представьте кадр вашего сознания».

Рисунок b): распальцовку из трех пальцев при фразе «представьте символ в центре карты».

И всё, дело сделано! При «голосовании» победила тройка бубен, и никто не заметил влияния на их выбор.

Так что ж, теперь слушать политиков и рекламу лишь по радио, а ТВ и Ютуб в отстой?

Получается так, если не хотите, чтобы вас развели на «магические жесты».

________________________________

Если понравился пост:

- нажимаете на кнопку аплодисментов, — автору будет приятно :-)

- подпишитесь на обновления канала на платформе Medium;

- оставьте комментарий.

Еще больше материалов на моем Телеграм канале «Малоизвестное интересное». Подпишитесь

Оригинал и комментарии

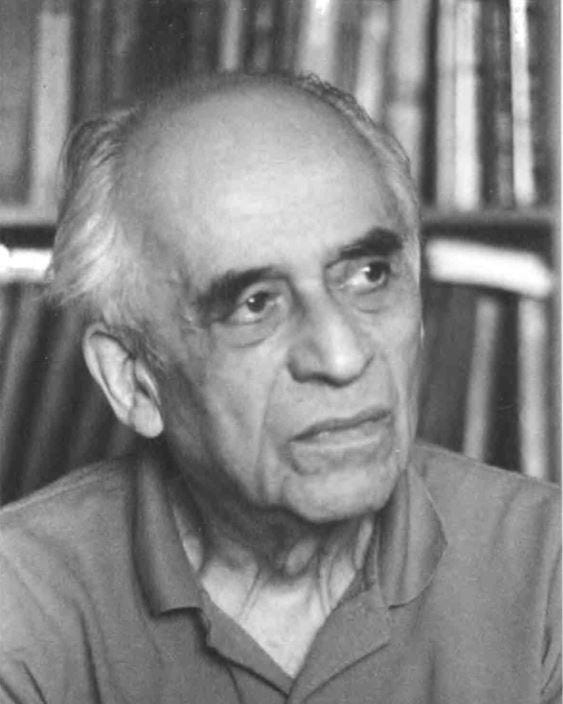

«Люди живут в мире мифов. Мифы формируются на основе личного опыта или извлекаются из той среды, в которой человек живет… Мифологично не только бытовое знание. Научное знание столь же мифологично… Жрецы науки поддерживают миф о всесильности науки. Часть из них делает это искренне, веря в миф о всесильности, а остальные не утруждают себя критикой того, что дает им право на работу и высокое положение в развитом обществе».

Эти слова основоположника советской школы искусственного интеллекта Дмитрия Александровича Поспелова написаны в 1997 году. На тот момент искусственный интеллект (ИИ), как самостоятельное научное направление существовал уже более четверти века. И тогда казалось, что будущее данного направления за интеллектуальными системами для правдоподобной аргументации, концептуальными моделями предметных областей, порождением объяснений и пониманием текстов, поиском релевантных знаний и построением интеллектуальных обучающих систем на основе метазнаний. Об этом Д.А. Поспелов писал в вышедшей годом раньше работе «Десять “горячих точек” в исследованиях по искусственному интеллекту».

Увы, но почти ничего из того, о чем писал Д.А.Поспелов в этой статье, не произошло. А произошло то, чего он никак не предполагал.

✔️ По прошествию двух десятилетий ИИ превратился в самую мифологизированную область прогресса, вокруг которой формируется новая техно-религия всезнания больших данных и всемогущества машинного обучения.

✔️ Целью этой техно-религии провозглашен «прорыв в техно-сингулярность», где супер-ИИ решит все нерешенные проблемы человечества и дарует людям неистощимое здоровье, прорыв к заоблачным вершинам знаний и даже вечную жизнь среди цифровых облаков, куда будет выгружаться оцифрованное сознание человека.

Однако, не предвидя такого поворота, Д.А. Поспелов все же назвал его возможную причину. Перефразируя его слова из приведенной выше цитаты, — причина произошедшей мифологизации в интересах «жрецов ИИ», поддерживающих миф о его всесильности. «Часть из них делает это искренне, а остальные не утруждают себя критикой того, что дает им право на работу и высокое положение в развитом обществе».

Так оно и происходит. С каждым настоящим достижением в области ИИ мы наблюдаем параллельный рост шумихи, мифов, заблуждений и неточностей. Эти недоразумения способствуют непрозрачности систем ИИ, делая их в глазах общественности волшебными, непостижимыми и недоступными.

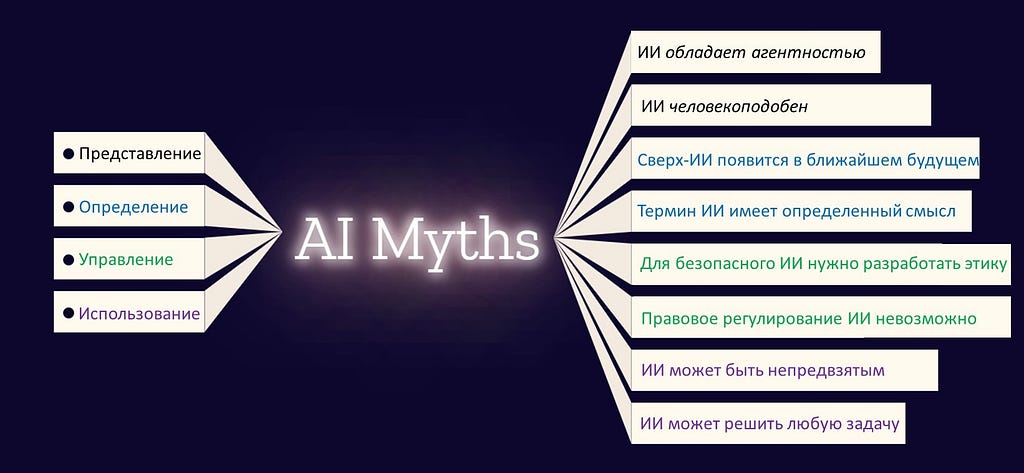

Цель проекта команды Даниэля Лойфера «Мифы об ИИ» — помочь распутать и развенчать некоторые из этих вводящих в заблуждение идей. Авторы проекта анализируют, как эти идеи появляются в средствах массовой информации, и указывают читателям высококачественные ресурсы для дальнейшего чтения.

Мне же остается, в качестве тизера этого проекта, кратко изложить структуру и свое представление о сути четырех направлений мифологии ИИ.

Представление — что из себя представляет ИИ

Mиф №1: ИИ обладает агентностью

Интеллектуальный агент может быть определен, как существо (не обязательно биологическое), самостоятельно действующее, движимое собственной мотивацией (определяемой собственными потребностями), и руководствуясь при этом собственными целями. ИИ таковым агентом не является, ибо он не воплощен и не имеет собственных потребностей, мотивации и целей. ИИ всего лишь набор алгоритмов, мотивацию и цели которых формируют его разработчики. Т.о. ИИ лишь следуют мотивации и целям создавших или использующих его людей, будучи при этом интеллектуальным агентом не более, чем смартфон или лаптоп.

Mиф №2: ИИ человекоподобен

Чтобы быть человекоподобной, машина должна реагировать на получаемые из окружающей среды стимулы в соответствии с традиционными реакциями людей, с учетом человеческих потребностей, а также способностей к созерцанию, суждениям и намерениям. И пока все это у машин отсутствует, они не могут считаться человекоподобными.

Определение — смысл термина и его толкования

Mиф №3: Сверх-ИИ появится в ближайшем будущем

Создание сверх-ИИ превратилось в главную цель развития ИИ, приближение к которой считается основным мерилом прогресса в этой области. Вместе с тем, сама возможность создания сверх-ИИ крайне проблематична, если это вообще возможно. В итоге, главной целью и мерилом прогресса ИИ остается химера. Это в значительной мере затрудняет прогресс в области ИИ, поскольку «кто не знает, куда плывет, тому нет и попутного ветра».

Mиф №4: Термин ИИ имеет определенный смысл

За 70+ лет своего существования, научное направления, названное ИИ, породило одно из главных направлений научно-технического прогресса. В современном мире ИИ воплощает в себе тысячи объектов исследований, продуктов и услуг, использующих интеллектуальные алгоритмы в сотнях областей применения. В результате этого, термин ИИ превратился в общую характеристику всех этих исследований, продуктов и услуг. При этом конкретный смысл данного термина сам по себе мало что говорит в отрыве от того, к чему он относится (подобно «электро», применимое теперь почти к чему угодно: электрооборудование, электроарматура, электроприборы, электроемкость, электролитье, электропоезд, электроэнергия, электротяга…)

Управление развитием разработок и внедрения ИИ

Mиф №5: Для безопасного ИИ нужно разработать этику

Все что мы называем ИИ — всего лишь инструменты, применение к которым этических принципов бессмысленно. И даже разработка таких принципов впрок — на случай, если когда-то ИИ обретет агентность, — пустое занятие. Для того, чтобы оснащенная ИИ электропила будущего не пилила людей, не нужна машинная этика. Вполне достаточно трех законов робототехники.

Mиф №6: Правовое регулирование ИИ невозможно

Аргументы, будто ИИ слишком сложен для регулирования, и что оно убьет инновации, несостоятельны и крайне опасны. Определение юридических рамок и «красных линий», ограничивающих разработку и применение технологий двойного назначения (коих в области ИИ уже много и их число будет расти и расти) — стандарт де-факто в современном мире. Без этого немыслимо выживание человечества в условиях постоянно возрастающих военных, террористических и техногенных рисков.

Использование ИИ

Mиф №7: ИИ может быть непредвзятым

Не являясь человекоподобным агентом, ИИ вбирает в себя всевозможные когнитивные искажения создателей своих алгоритмов. Другим неизбежным источником предвзятости ИИ служат данные, используемые в процессе машинного обучения ИИ. Создатели алгоритмов — не идеальные существа. А свойства и качества данных зависят от множества факторов (кто, где и как их собирает). В результате непредвзятость становится недостижимым идеалом для ИИ, не реализуемым на практике.

Mиф №8: ИИ может решить любую задачу

Современные ИИ системы, построенные, в основном, на алгоритмах глубокого обучения, могут эффективно решать лишь задачи, стоящие перед человеческим восприятием (зрение, слух …) и человеческими двигательными действиями (действия рук, ног, тела). Задачи, решаемые мозгом человека, эффективно реализуемы ИИ, лишь если задача описывается строгой системой правил. Круг таких задач, за пределами игр, весьма ограничен. Для решения огромного множества задач, не решаемых современным ИИ, необходимо искать иные способы его реализации.

В завершение тизера забавная иллюстрация к мифу №4 “Термин ИИ имеет определенный смысл”. Подставьте в нижеследующий текст вместо слов “искусственный интеллект” любое сочетание слов из приведенных под текстом или придуманных вами (например, “изысканный сепульк” или “умудренный крокодавр”). Мифологичность текста от такой замены ничуть не изменится. 😊

P.S. Читать о мифологии прорывных направлений науки куда интересней, чем о банальных фейк-ньюс. Про пять мифов о сознании я писал здесь.

________________________________

Если понравился пост:

- нажимаете на кнопку аплодисментов, — автору будет приятно :-)

- подпишитесь на обновления канала на платформе Medium;

- оставьте комментарий.

Еще больше материалов на моем Телеграм канале «Малоизвестное интересное». Подпишитесь

Оригинал и комментарии

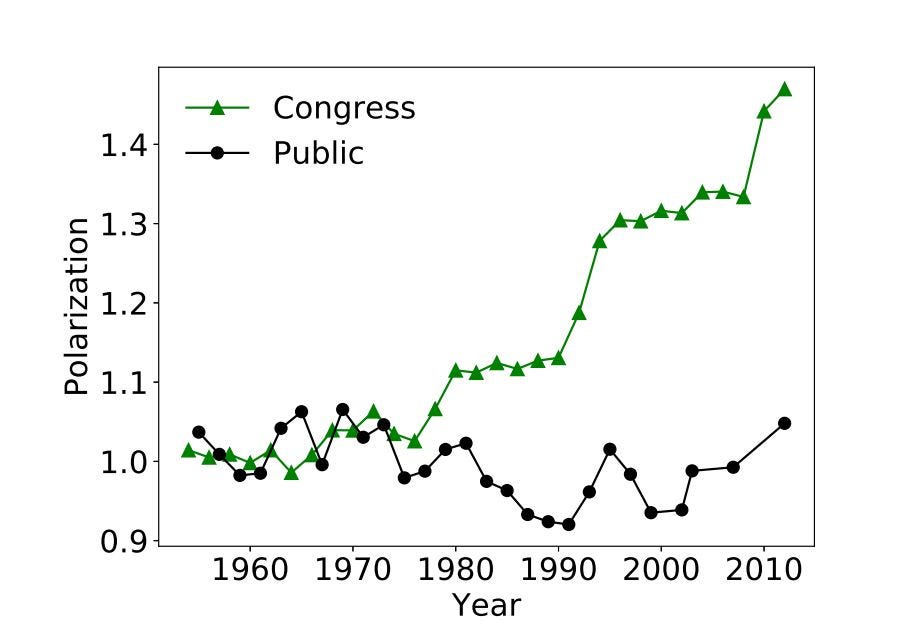

Новость в том, что в политике люди оказались столь же нерациональны, как и в экономике. В результате этого, политический раскол провоцируют не «злобные элиты», а сам народ своей нерациональностью.

События в Беларуси начинают все более напоминать Венесуэлу (Лукашенко в роли Мадуро, а Тихоновская в роли Гуайдо). Позиции политических противников все более поляризуются. И это вполне соответствует глобальному тренду политической поляризации, наблюдаемому в большинстве демократических стран. И США, между прочим, в этом тренде явный лидер.

Казалось бы, что может быть общего в столь разных обществах, следствием чего становится нарастающий политический раскол? Похоже, ответ найден — человеческая нерациональность в принятии политических решений.

Нобелевскую премию 2017 получил профессор Чикагского университета Ричард Талер за «вклад в изучение поведенческой экономики». Нобелевский комитет отметил, что исследования Талера «создали мост между экономикой и психологическим анализом индивидуальных решений». Эти исследования показали:

экономический выбор людей зачастую нерационален. Эта, мягко говоря, ограниченная рациональность, в основе которой социальные предпочтения, эмоциональные и когнитивные факторы, — сильно влияет на принятие людьми экономических решений.

Новое открытие, имхо также тянущее на Нобеля, переносит выводы Талера с экономики на политику. Только что опубликованное исследование «Why are U.S. Parties So Polarized? A “Satisficing“ Dynamical Model» показывает,

что при голосовании на выборах люди не рациональны, а вместо этого руководствуются принципом «разумной достаточности».

Но это, как говорится, цветочки. А ягодки — это нарастание раскола (следствие такого принципа выбора).

Второй удивительный вывод исследования — объяснение неразрешимого доселе вопроса, почему в демократических странах неуклонно растет политическая поляризация. Оказывается, тренд на поляризацию идет не от элиты (политических партий), а от самого народа. Будучи нерациональными, люди вовсе не пытаются максимизировать собственную выгоду, а предпочитают голосовать (или не голосовать), особенно не заморачиваясь. Такой нерациональный выбор заставляет конкурирующие партии менять стратегию борьбы за голоса. И вместо смещения к политическому центру (стратегии — выгодной для партий в случае «рациональных избирателей»), позиции партий все более поляризуются. Такая политическая стратегия оказывается максимально эффективной, когда имеешь дело с «нерациональными избирателями».

Трактовка общества, как «рациональных избирателей», лежит в основе большинства политических моделей демократии. Например, модель, предложенная в 1950-х годах экономистом Энтони Даунсом, популярна благодаря своей простоте. Но беда в том, что эта модель в одном важном моменте не соответствует эмпирическим данным. Модель Даунса предполагает, что голосуют все, а избиратели выбирают кандидата, идеологически наиболее близкого их мнению. Такое предположение кажется достаточно логичным. Однако модель предсказывает, что политические партии должны со временем смещаться к центру политического спектра, чтобы получить наибольшее количество голосов. А в жизни все с точностью до наоборот. И США здесь отличный пример, т.к. здесь нарастание раскола неуклонно происходит с середины 1970-х.

Предложенная в новом исследовании модель отменяет рациональность выбора избирателя.

Средний избиратель особенно не заморачивается с расчетом потенциальных выгод от своего выбора, а просто следует принципу «разумной достаточности»:

- если он доволен кандидатом, то отдает ему свой голос;

- если его на вскидку устраивают любой из кандидатов (или просто влом разбираться, программа какого из них принесет избирателю больше пользы), то голосование проводится по методу «орёл или решка»;

- а если его не устраивает ни одна из сторон (или ехать на голосование с дачи сильно не хочется), он просто забивает на выборы и не голосует.

Тестовые прогоны такой модели, где избиратели следуют не рациональной стратегии, а принципу «разумной достаточности», выявили оптимальную стратегию борьбы за голоса избирателей.

Исследователи обнаружили, что политические противники увеличивают вероятность получения голосов, когда они идеологически уходят как можно дальше от середины политического спектра.

Вот и всё объянение нарастания поляризации в демократических странах.

Получается, что Homo оказался не такой уж sapiens не только в экономике, но и в политике. И с рацио у людей явные проблемы.

Что же до русских людей, то у нас принцип «разумной достаточности» вообще главный.

«И так сойдет» — это точно про нас.

И в экономике, и в политике, и ….

________________________________

Если понравился пост:

- нажимаете на кнопку аплодисментов, — автору будет приятно :-)

- подпишитесь на обновления канала на платформе Medium;

- оставьте комментарий.

Еще больше материалов на моем Телеграм канале «Малоизвестное интересное». Подпишитесь

Оригинал и комментарии

Подтверждение теории светоносных глаз

Первое в мире экспериментальное исследование эффекта «отклонения взгляда» дало удивительные результаты. Этот эффект знаком любому.

Допустим, вы в вагоне метро. Ваше внимание чем-то привлекла читающая девушка, сидящая в паре метров от вас. Вы внимательно смотрите на нее. И вдруг она мгновенно поднимает глаза от книги и смотрим прямо вам в глаза. Вы резко отворачиваетесь в другую сторону, как будто она поймала вас на подсматривании ее интимных подробностей.

Подобное случалось многократно с каждым из нас. Естественно, на месте девушки может быть человек любого пола и возраста. Но одно неизменно. Как только ваш взгляд «поймали», вы резко отворачиваетесь — вот так.

И делаете это рефлекторно. Также, как отдергиваете руку от раскаленной поверхности.

Почему мы так делаем? Какая зашитая в нас эволюцией программа заставляет делать это? Чего мы опасаемся или чего хотим достичь, резкой переменой направления нашего «пойманного» кем-то взгляда?

Совместное экспериментальное исследование Йельского и Гарвардского универов показало: модель состояния внимания другого человека, существующая в мозге каждого из нас, ориентирована не на отслеживание его глаз, а на попытки чтения по глазам его мыслей.

Но как и почему эволюция встроила в нас именно такую модель? Зачем это ей? Ведь читать по выражению глаз мысли других невозможно, и никаких лучей мысли глаза не излучают.

Оказалось, не совсем так. И еще древние греки об этом знали.

Платон в своем знаменитом естественнонаучном диалоге «Тимей» писал: «Из органов боги, прежде всего, устроили светоносные глаза … И боги сделали так, что родственный дневному свету огонь, находящийся внутри нас, вытекает очищенным через глаза». А великие математики древности — Евклид, Птолемей и др. — на основе учения о зрительных лучах, исходящих из глаз, создали теорию отражения света, заложив основу геометрической оптике.

Последняя не потеряла значения и поныне. А вот учение о зрительных лучах признано лженаукой. И оказалось, зря.

- Во-первых, недавнее исследование Принстонского универа показало, что эволюция, весьма возможно, встроила в мозг имплицитную модель зрительного внимания других людей как невидимый, несущий силу луч, исходящий из глаз.

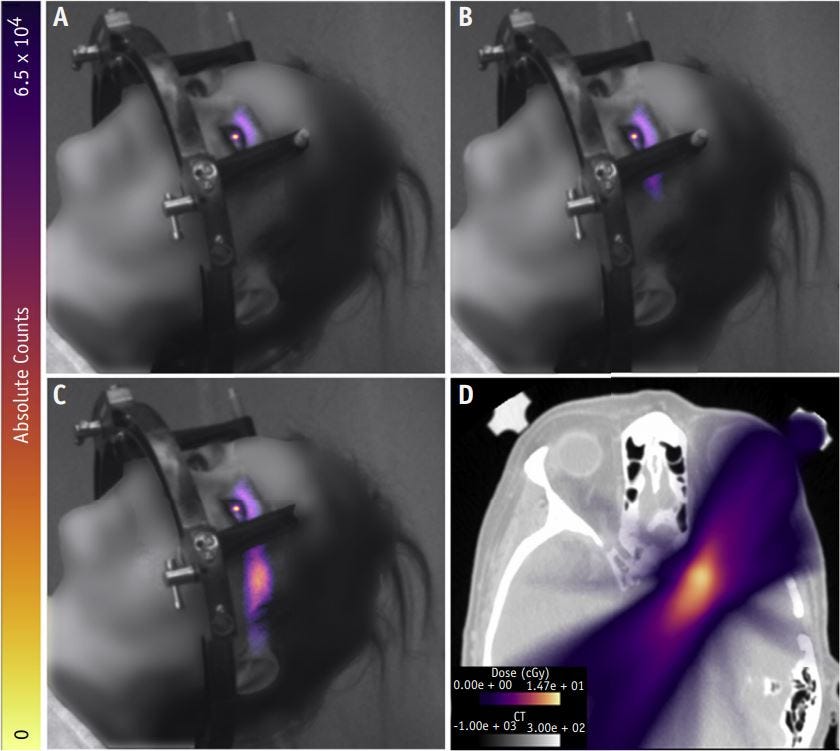

- Во-вторых, как показало недавнее авторитетнейшее международное исследование на стыке биологии с физикой, — Платон был прав: глаза действительно светоносны. Было достоверно зафиксировано световое излучение из глаз людей, проходящих лучевую терапию. Этот свет похож на черенковское излучение (возникает при движении заряженной частицы в прозрачной среде со скоростью большей скорости света в этой среде) и имеет синий цвет, подобно свету, исходящему от окруженных водой ядерных реакторов.

Суммируя названные 3 исследования, получается одно из двух.

✔️ Либо со временем обнаружится светоносность глаз и без воздействия лучевой терапии. И значит, читать мысли по глазам мозг таки умеет.

✔️ Либо эволюция решила в целях повышения нашей приспособленности закодировать в нашем мозге ошибочную модель восприятия внимания других, в основе которой излучение чужих глаз.

В пользу 2го варианта говорит то, что он для эволюции типовой. Так появились запаянные в нас десятки когнитивных искажений, включая главное — о высочайшей цели собственного существования. Эволюция, в этом смысле, действует тупо, но оптимально. Наплевать, что эта модель реальности (и поведения) ошибочна. Зато она лучше приспособлена для выживания.

Вот и хлебаем мы по жизни из-за своих когнитивных искажений. Но зато выжили.

________________________________

Если понравился пост:

- нажимаете на кнопку аплодисментов, — автору будет приятно :-)

- подпишитесь на обновления канала на платформе Medium;

- оставьте комментарий.

Еще больше материалов на моем Телеграм канале «Малоизвестное интересное». Подпишитесь

Оригинал и комментарии

И рыскать глазами тоже

Читатели бурно реагируют на мой вчерашний пост об эффекте «отклонения взгляда». Еще бы. Ведь каждый из нас не раз сталкивался с ним. Кроме того, оба его объяснения весьма интригующие: (1) отражающая наши мысли светоносность глаз; (2) ошибочная нейро-модель, умышленно закодированная в нашем мозге эволюцией, дабы повысить нашу приспособляемость.

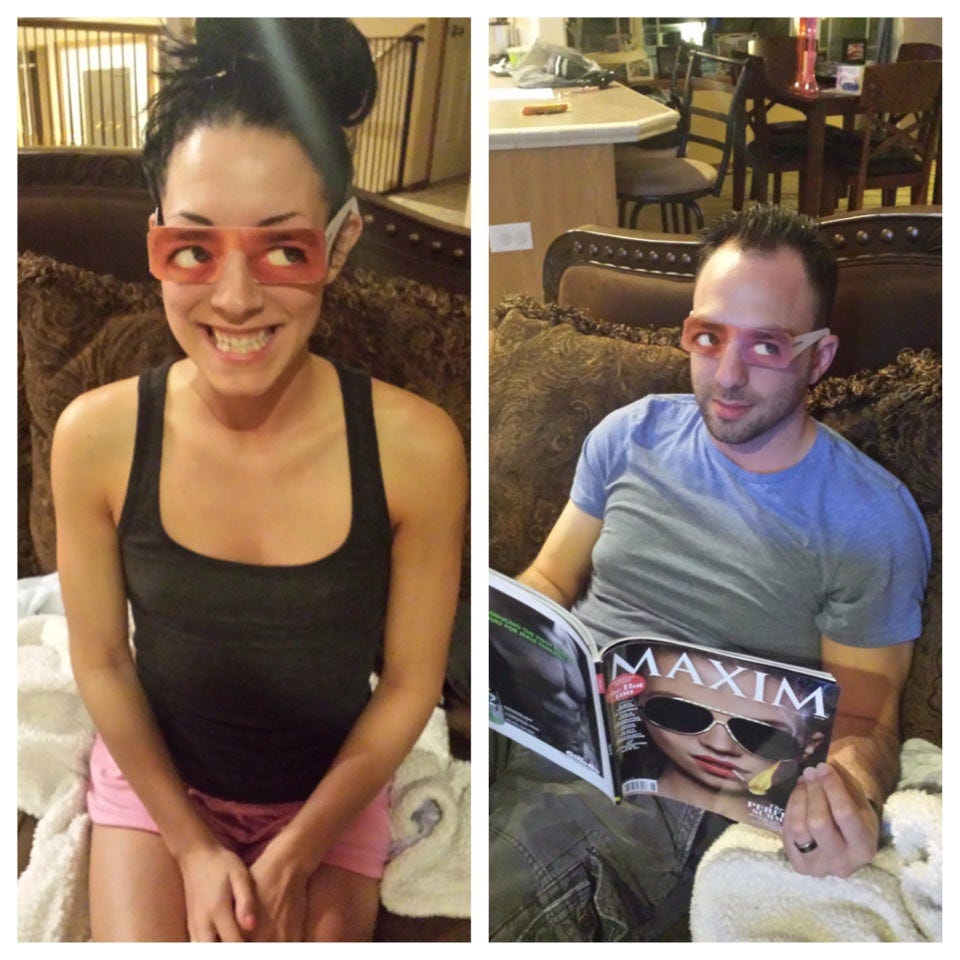

Я закончил вчерашний пост на том, что 2я (эволюционная) версия видится мне более вероятной. А пытливый читатель подбросил мне изумительно-прикольный пример. Он иллюстрирует эволюционную природу особой реакции нашей ближайшей родни — приматов на тот факт, что кто-то на них чересчур внимательно смотрит.

Вот так — с помощью картонных очков с нарисованными отведенными вбок глазами и дырочками, позволяющими сквозь них видеть, — посетителей зоопарка Роттердама спасают от прямого контакта глаза-в-глаза с гориллами.

Инициатива раздавать спецочки посетителям обезьянника принадлежит страховой компании, изрядно потратившейся на выплаты возмещения за физический и моральный ущерб посетительнице зоопарка, решившей поиграть в гляделки с гориллой. Итог игры оказался весьма печальным для дамы, поскольку гориллы не выносят контакта глаза-в-глаза. А что будет при игре в гляделки с альфа-самцом, посмотрите на видео.

Здесь посетителей спасает тройное стекло для небоскребов. Но и его приходится часто менять после ударов горилл, в сравнении с которыми нокауты Майка Тайсона — все равно, что щекотка.

Вот такое интересное подтверждение эволюционной природы особой реакции на контакт глаза-в-глаза. Ну а очки, понятное дело нашли спрос и за пределами зоопарков. Вуайеристам и прочим, опасающимся быть пойманными на “рысканье глазами”, такие очки — спасение.

И даже рекламный лозунг есть.

«Bokito Kijker Eyewear Lets You Spy Stealthily»

Так что эволюция эволюцией, а маркетинг маркетингом 😆

________________________________

Если понравился пост:

- нажимаете на кнопку аплодисментов, — автору будет приятно :-)

- подпишитесь на обновления канала на платформе Medium;

- оставьте комментарий.

Еще больше материалов на моем Телеграм канале «Малоизвестное интересное». Подпишитесь

Оригинал и комментарии

Оригинал и комментарии

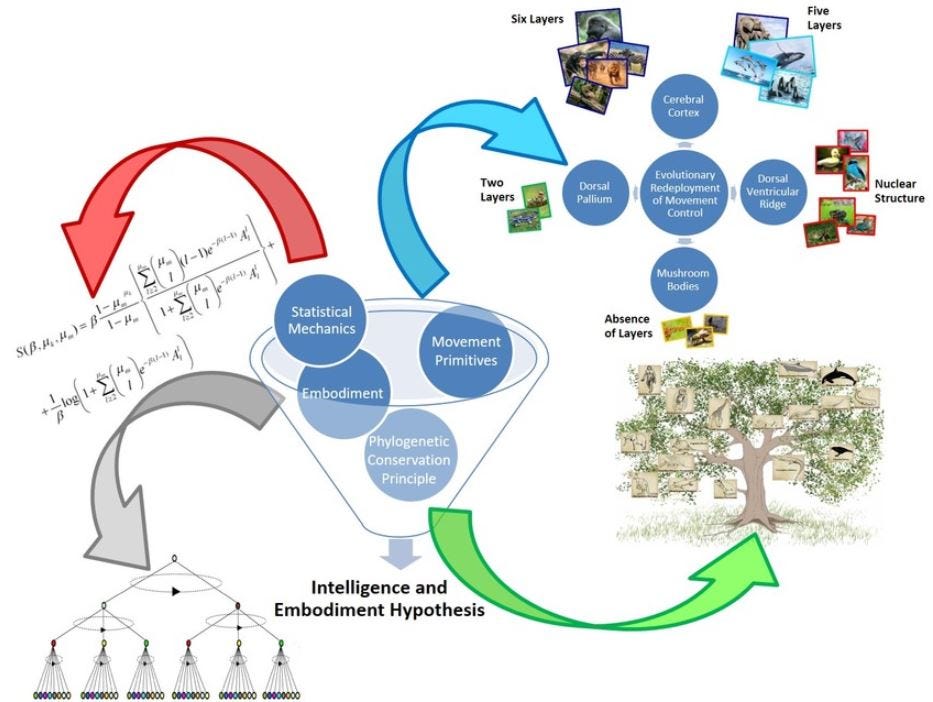

За которой маячит революция AGI

Проясняется, на что рассчитывает DeepMind, прожигая миллиарды. И честно говоря, задача того стоит. Это действительно ИИ общего назначения (AGI). Собственно, руководство DeepMind этого и не скрывало. Но вот как они планируют этого добиться, было непонятно. А теперь проясняется.

Стратегическая логика здесь такова

- AGI должен быть воплощенным.

Значит полагаться только на алгоритмы настольных и компьютерных игр (всякие там AlphaGo, Alphazero … ) нет смысла. - Значит речь о роботах, материализованных и действующих в физическом мире.

- Первейший ключевой навык для робота — движение (сенсорно-моторные навыки, направленные на достижения цели). И главный фокус здесь в том, чтобы для обучения движению роботу не требовалось море данных, как это принято у алгоритмов типа Alphazero. Надо чтобы робот попробовал некое разумное число раз, — и научился.

- Но движение бывает разное. Для муравья, воробья и карася — это совсем не одно и то же (разные среды). Более того: для сухопутных паука, червяка и барсука– это тоже совсем не одно и то же (разные способы и механизмы движения).

Значит нужно, чтобы робот мог самостоятельно учиться УНИВЕРСАЛЬНОМУ движению. - Что потом? Да понятно что. Ведь из примитивов универсального движения, возможно, и складывается механизм мышления. И значит, второе может быть получено на основе первого.

К реализации п. 3 DeepMind приступил 2 года назад, создав новую парадигму обучения — Scheduled Auxiliary Control или SAC-X (запланированное вспомогательное управление). Подробней см. здесь.

Парадигма SAC-X основана на идее, что для выполнения сложных задач ИИ должен сначала научиться исследовать доступную зону и овладеть набором базовых навыков.

С реализацией п. 4 связана опубликованная на днях работа «Towards General and Autonomous Learning of Core Skills: A Case Study in Locomotion». В ней на основе SAC-X предложено универсальное решение управления моторикой непосредственно из исходных сенсорных входов. DeepMind разработал систему обучения, которая может учиться сложному поведению локомоции для широкого спектра N-ногих роботов, таких как двуногие, трехногие, четвероногие, шестиногие … включая колесные варианты (см. видео)

DeepMind сделал это, не изменив функции вознаграждения для разных роботов. Их подход позволяет научиться управлять новыми роботами всего за пару часов. Суть подхода в том, что он многозадачен: эффективнее пытаться учиться сразу нескольким навыкам, а не учиться им последовательно.

Если новый подход DeepMind взлетит, — это будет революция в мире роботов.

Ну а дальше будут пытаться реализовать п.5.

Благо зацепки, как из примитивов универсального движения эволюционно получить примитивы мышления уже есть. И хотя это было пока что сделано только для дельфинов (для их локомоции в водной среде), но и с универсальным движением может получиться.

И тогда случится революция AGI.

________________________________

Если понравился пост:

- нажимаете на кнопку аплодисментов, — автору будет приятно :-)

- подпишитесь на обновления канала на платформе Medium;

- оставьте комментарий.

Еще больше материалов на моем Телеграм канале «Малоизвестное интересное». Подпишитесь

Оригинал и комментарии

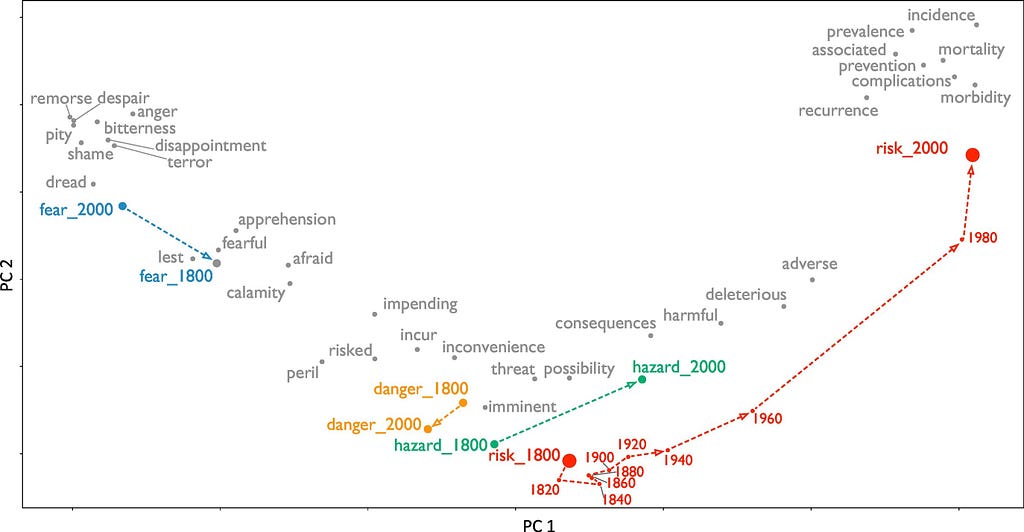

А рака — больше ядерной войны

Риск — абстракция, социальный конструкт на основе норм, морали, социальной организации и конкретики деятельности.

Риск трактуется по-разному. В страховании — это потери (травмы, смертность …), взвешенные по вероятности их наступления. В экономике — разница в возможной доходности. И т.д.

Риск подвержен социальным изменениям. Раньше были иные риски и к ним относились иначе. Тысячи лет главными рисками были голод, инфекции и насилие. Сейчас же все меняется. Но как, и в какую сторону?

Голода мы уже не боимся (почти, — иначе зачем временами запасаем гречку). С насилием вроде стало получше. А вот насчет инфекций, с приходом COVID-19, похоже, все возвратилось на круги своя — опять боимся.

До сих пор копья ломались в основном вокруг вопроса — стал ли мир опасней и рискованней? (читайте Пинкера, Харари, Талеба, Фергюсона, а если быстро и про всех сразу, — то меня).

Но на другой, не менее важный вопрос, — стало ли наше отношение к риску иным? — ответа до сих пор не было. И вот он получен.

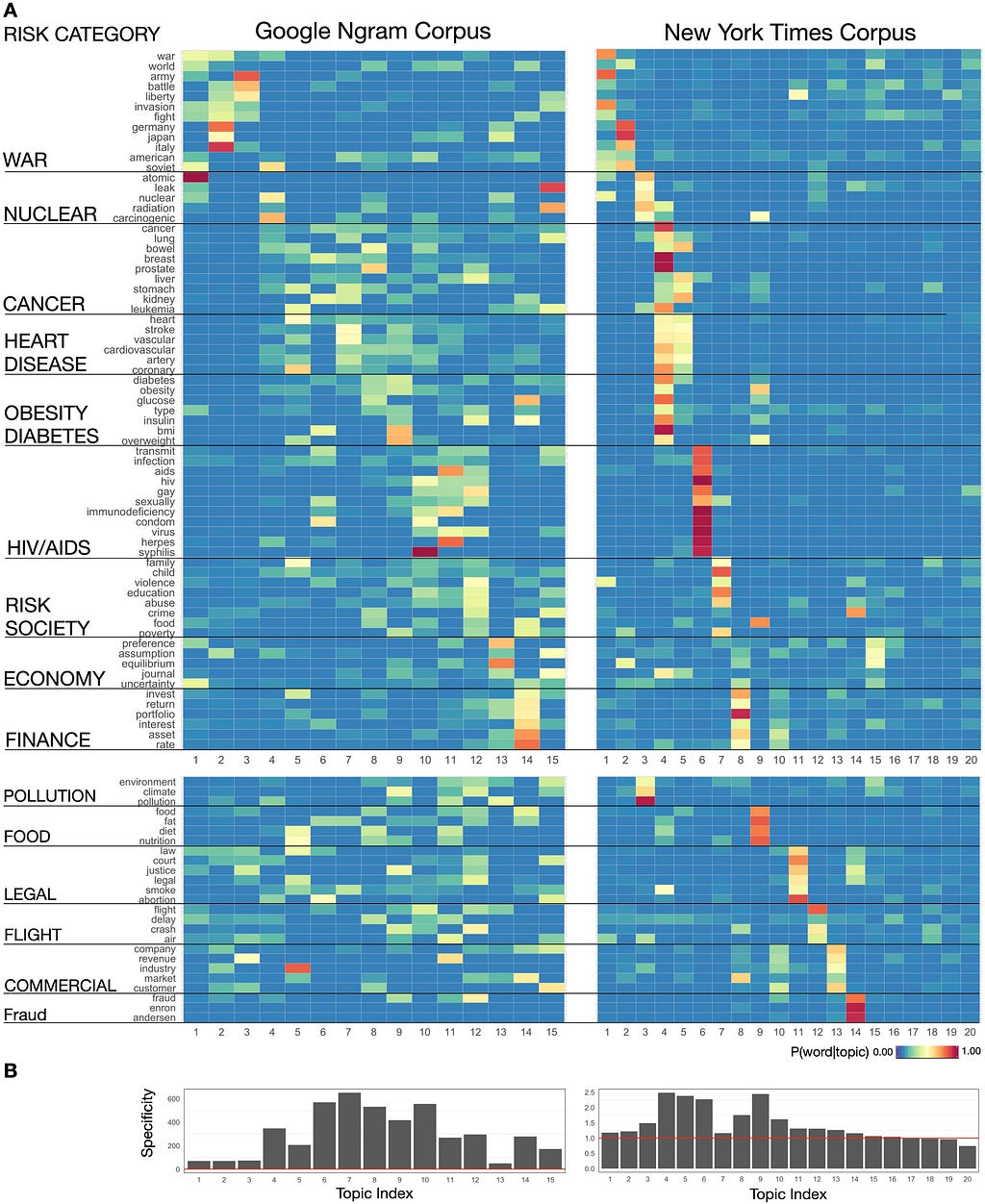

Авторы придумали ловкую методику на основе компьютерной обработки колоссальных объемов текстов. Ведь если современных людей можно опросить на тему их отношения к рискам, то живших 50, 100, 200 лет назад уже не опросишь. Но сохранилась уйма текстов, которые можно анализировать. Что и сделали авторы исследования из немецкого Института имени Макса Планка и Департамента психологии британского университета Уорвика. Они проанализировали 8+ млн книг, изданных с 1600 по 2008 и архив NYT за 1987–2007.

Ставились задачи:

- выявить паттерны употребления слов в контексте понятия «риск», отражающие изменения культурной значимости риска;

- выявить, как изменилось отношение к словам, связанным с риском;

- исследовать изменение семантических отношений между риском и связанными с ним понятиями;

- выявить наиболее заметные темы риска с течением времени и рассмотреть, как они изменились в связи с мировыми событиями.

Результаты читаются не менее увлекательно, чем новый пелевинский опус «Непобедимое солнце». И результатов много, причем, весьма интересных и неожиданных.

Вот мой субъективный выбор — по одному выводу на каждый из 4х поставленных вопросов (в работе выводов куда больше).

- Роль и место риска в культуре выросла многократно (только с 1950 рост в 4 раза) — мир стал куда более рисковый. Это проверено не только для английского языка. Аналогично во французском, немецком, итальянском и испанском мире.

- Понимание риска и контекст сильнейшим образом изменились, но публичный дискурс от этого не стал более мрачным. Все как и прежде — «Люди, как люди… Ну, легкомысленны ну, что ж обыкновенные люди».

- За 200 лет топ-5 ближайших семантических соседей слова риск изменились:

— в 1820 — «потери, расходы, опасности, неприятности, ценные бумаги»;

— в 2000 — «болезни, диабет, рак, рейты, факторы». - Тема войны уже мало кого беспокоит. Больше боятся болезней сердца, рака, диабета и ВИЧ/СПИД. Также максимальный риск ассоциируется с «едой, жиром, диетой».

Таким вот оказалось восприятие риска в дивном новом мире 21 века.

Риски хронических заболеваний и неЗОЖа нынче волнуют человечество куда сильнее экзистенциальных рисков ядерной войны, изменения климата и подрывных ИИ-Био технологий.

И если до сих пор в непонимании главных рисков человечества винили политиков, бизнесменов и мегакорпорации IT, то теперь становится ясно — они всего лишь следуют в кильватере чаяний и опасений человечества. А оно продолжает впадать в детство, становясь все более себялюбивым и недалеким.

Что ж, флаг нам в руки! Как говорится, кто не курит и не пьёт, …

________________________________

Если понравился пост:

- нажимаете на кнопку аплодисментов, — автору будет приятно :-)

- подпишитесь на обновления канала на платформе Medium;

- оставьте комментарий.

Еще больше материалов на моем Телеграм канале «Малоизвестное интересное». Подпишитесь

Оригинал и комментарии

Фейковая победа ИИ в воздушном бое

Ширнармассы получили новое подтверждение — супер-ИИ уже на подходе. В шахматы ИИ людей обыграл, в Го и покер тоже. Ну а теперь уже не игры, а самое серьезное из дел — война. Целую неделю техноэнтузиасты и бизнес-бенефициары ИИ с восторгом рассказавают ширнармассам, что в воздушном бою истребителей ИИ, как Тузик грелку, порвал летчика-аса. При этом особый восторг выражается по части того, что в воздушном бою, как и в играх, алгоритмы не просто действуют сильнее людей, а действуют совсем по-другому — так, как людям и в голову не приходит.

Но все подобные рассказы — 100%ный фейк. Чистой воды постановочное шоу с единственной целью — под шумиху в медиа выбивать новый бюджеты. Ну а зачем этот низкопробный театр рекламируют в медиа, — спрашивать бессмысленно. Тизер «человек укусил собаку» сегодня звучит «ИИ победил в собачьих боях». Именно так — Dogfight, — называется тот тип воздушного боя, в котором ИИ победил человека.

«Собачий бой» — это бой боевых самолетов на предельно малом расстоянии, когда они маневрируют на грани предельного риска, как для самолета (из-за потери управляемости), так и для пилота (из-за предельных перегрузок).

«В таком бою у человека не было ни шанса».

Так написала про этот «театр» Missy Cummings — одна из редких высочайших профессионалов, одинаково хорошо разбирающаяся в ИИ (профессор робототехники) и воздушном бое (одна из первых женщин-летчиц истребителей ВМС США).

Это как соревноваться с ИИ-автопилотом в том, кто первым свернёт, несясь на 250 км/час лоб в лоб. У него и «нервы» крепче, и реакция не в пример человеческой, да и себя ему совсем не жалко, в отличии от нас — белковых дрожащих и потеющих от страха тварей.

Кроме того, такой стиль маньяка-камикадзе не может пригодиться и в бою дронов. Зачем вообще стращать противника, проносясь мимо в 3х метрах, если можно шваркнуть по нему из пушки с дальнего расстояния. Поэтому «собачий бой» с его тараном в стиле штабс-капитана Нестерова или «подрубанием» винтами хвост противника, давным-давно забыли. Современное искусство воздушного боя в том, чтобы первым обнаружить противника в воздухе и сбить его ракетой до того, как он обнаружит тебя.

Что же до тактики ИИ, победившего несчастного пилота, то в ВВС США она запрещена: и лобовые атаки и подлет к противнику ближе 150 м. Это позволяет избежать столкновения самолетов в воздухе и попадание истребителя в облако обломков взорвавшегося противника. Более того, летчиков учат держаться подальше от противника, дабы расширить возможности маневра, наведения на цель и уклонения от обстрела. Ну а ИИ на всё это забил, действуя против всех существующих правил и ведя себя, как сумасшедший с бензопилой.

Объяснять дальше этот фейк, думаю, нет нужды.

А как же на самом деле обстоят дела с военным автопилотом?

Почитайте Missy Cummings, она в этом спец. А если в 2х словах, то так:

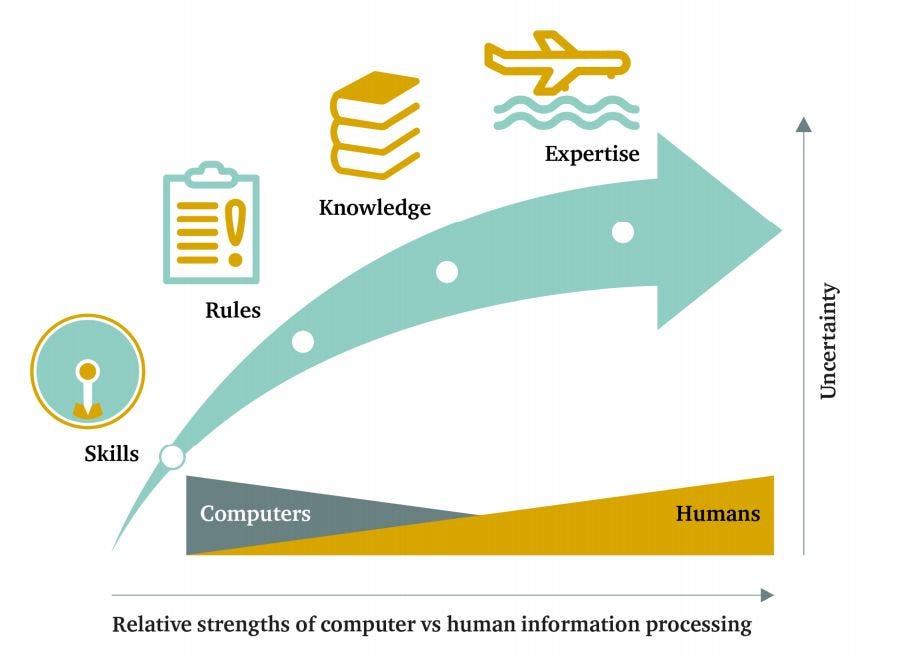

✔️ ИИ превосходит людей в некоторых задачах, основанных на навыках и правилах. Однако, в ситуациях, требующих суждений и знаний при наличии значительной неопределенности, люди несравненно сильнее ИИ.

✔️ Посему ИИ — отличная штука в конфигурации кентавра с человеком. ИИ разгружает пилота от рутины, филигранно выполняя действия, описываемые правилами, пока человек думает, оценивает, соизмеряет стратегию с тактикой и принимает решения.

________________________________

Если понравился пост:

- нажимаете на кнопку аплодисментов, — автору будет приятно :-)

- подпишитесь на обновления канала на платформе Medium;

- оставьте комментарий.

Еще больше материалов на моем Телеграм канале «Малоизвестное интересное». Подпишитесь

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оригинал и комментарии

Оставить отзыв с помощью аккаунта FaceBook:

ЖЖ Топ-50 постов сегодня

ЖЖ Топ-50 постов сегодня